Les modèles ARMA (AutoRegressive Moving Average) sont parmi les plus utilisés pour analyser et prédire l’évolution de séries chronologiques stationnaires. Ils combinent deux composantes :

- l’autorégression (AR), qui fait appel à la mémoire du passé ;

- la moyenne mobile (MA), qui apprend des erreurs précédentes pour améliorer la prévision.

Le modèle autorégressif (AR) – la résonance du passé

Le principe fondamental d’un modèle AR consiste à utiliser les valeurs passées d’une série pour prédire les valeurs futures ; en d’autres termes, l’idée que les données d’aujourd’hui portent l’écho des jours précédents. L’autocorrélation joue ici un rôle clé : elle permet de mesurer cette mémoire temporelle et de révéler les rythmes sous-jacents de phénomènes comme la propagation de maladies infectieuses.

L’analyse de la relation entre une observation à l’instant t, noté \(y_t\), et celles qui la précèdent, \(y_{t-1}\), permet de modéliser la dépendance entre le passé et le présent.

Ainsi, un modèle AR d’ordre p, dénoté AR(p), est défini par la relation :

où :

- \(y_t\) est la valeur observée de la série au temps \(t\) ;

- \(\mu\) est la moyenne de la série ;

- \(\varepsilon_t\) est un terme d’erreur aléatoire, souvent appelé bruit blanc ;

- les \(\phi_i\) représentent l’influence des \(p\) valeurs passées sur la valeur actuelle.

Il faut noter que la présence de \(\mu\) n’est pas toujours explicite. Dans une série centrée (de moyenne nulle), il est généralement omis des formules, c’est-à-dire que l’on considère implicitement \(\mu = 0\). Il sert surtout à ajuster la série autour de sa moyenne constante, ce qui peut être utile dans certaines applications.

Dans ce type de modèle, les coefficients d’autocorrélation partielle (théoriques), notés \(\phi_{k,k}\), deviennent nuls pour \(k > p\), tandis que les coefficients d’autocorrélation décroissent (en valeur absolue) vers 0.

Dans l’activité 1, on a vu que :

- le paramètre \(k\) représente le décalage temporel (ou lag), c’est-à-dire la distance entre deux observations dans le temps ;

- l’autocorrélation (ACF) mesure la corrélation globale entre les valeurs d’une série séparées par \(k\) périodes ;

- l’autocorrélation partielle (PACF) isole la relation directe entre deux valeurs à \(k\) périodes d’intervalle, en neutralisant l’effet des valeurs intermédiaires.

Ainsi, lorsque la PACF devient nulle pour tous les décalages \(k > p\), cela indique que les influences du passé au-delà de \(\boldsymbol{p}\) périodes sont négligeables, un comportement caractéristique d’un processus AR(p).

Pour que le modèle ![]() soit valide, certaines conditions de stationnarité doivent être respectées.

soit valide, certaines conditions de stationnarité doivent être respectées.

- Pour un cas simple d’ordre 1, AR(1), il faut que :

\(-1 \lt \phi_1 \lt 1\)

Si \(\phi_1 = 1\), on obtient alors un modèle de marche aléatoire, c’est-à-dire une série non stationnaire où les fluctuations s’accumulent au fil du temps.

-

Pour un modèle d’ordre 2, AR(2), la stationnarité exige que la combinaison des coefficients respecte certaines bornes mathématiques :

\(|\phi_1| + \phi_2 \lt 1\) et \(\phi_2 \gt -1\)

-

Plus généralement, le modèle est stationnaire si les racines (possiblement complexes) du polynôme

\(\phi(z) = 1 – \phi_1 z – \cdots – \phi_p z^p\)

sont à l’extérieur du cercle unité.

Un exemple pratique : illustration d’un modèle AR

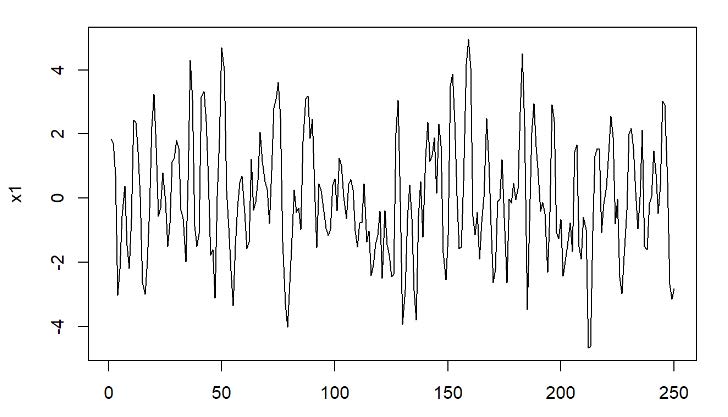

Pour mieux visualiser le comportement d’un modèle autorégressif, considérons une série temporelle simulée selon la relation :

$$y_t = 0,9y_{t-1} – 0,5y_{t-2} + \epsilon_t$$

Cette équation correspond à un modèle AR(2), donc un processus de série chronologique où la valeur observée à un instant \(t\) dépend des deux valeurs précédentes (p = 2).

Les coefficients \(\phi_1 = 0,9\) et \(\phi_2 = -0,5\) traduisent la force et la direction de la dépendance temporelle :

- le coefficient positif \(\phi_1 = 0,9\) indique une forte relation directe entre \(y_t\) et la valeur précédente \(y_{t-1}\) : si la série augmente à une période donnée, elle aura tendance à rester élevée à la période suivante ;

- le coefficient négatif \(\phi_2 = -0,5\) traduit un effet correctif à plus long terme : la valeur d’il y a deux périodes agit en sens inverse, contribuant à ramener la série vers sa moyenne ;

- le terme \(\varepsilon_t\) correspond au bruit, c’est-à-dire à une fluctuation aléatoire qui ne dépend d’aucune valeur passée.

Cette combinaison d’effets positifs et négatifs produit des oscillations régulières autour de la moyenne, un comportement typique des modèles AR(2). Autrement dit, le passé influence le présent avec une mémoire qui s’amortit progressivement : la dynamique résulte d’un équilibre entre inertie et retour vers la stabilité.

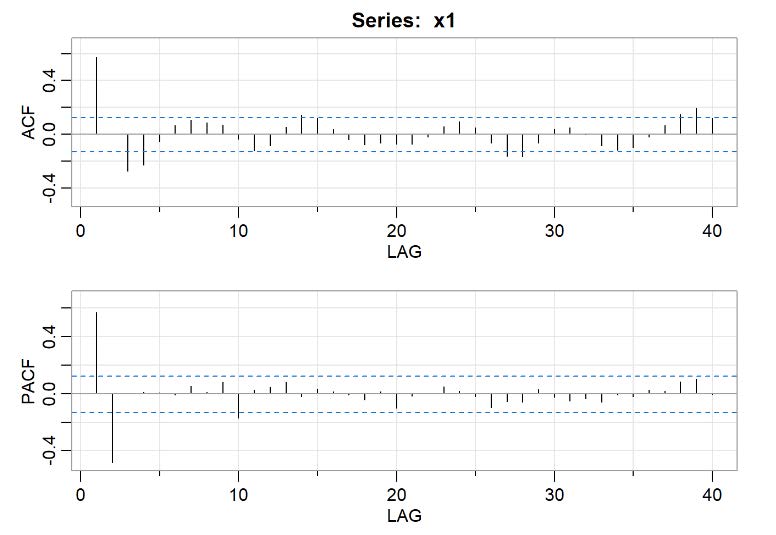

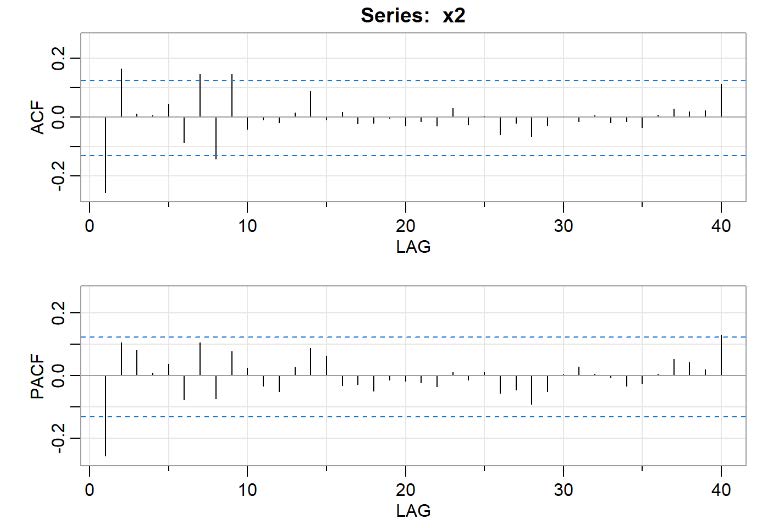

Les barres de l’ACF et de la PACF qui dépassent les bandes bleues représentent des valeurs significativement différentes de 0.

Notez que les conditions de stationnarité de ce modèle sont bien respectées :

\(0,9 = |\phi_1| \lt 1 – \phi_2 = 1,5\) et \(-0,5 = \phi_2 > -1\)

Cela signifie que la série reste stable dans le temps, sans dérive ni explosion de ses valeurs, ce qui peut aussi être corroboré dans les graphiques.

Représentation graphique de la série temporelle \(X_1\)

- La série \(X_1\) présente des oscillations régulières autour d’une moyenne stable. On retrouve ici le concept présenté dans l’activité 1 : les valeurs successives ne sont pas indépendantes, mais liées entre elles par une mémoire temporelle.

- Chaque observation dépend partiellement des précédentes, créant des cycles ou des ondulations visibles dans le graphique.

Représentations graphiques des fonctions ACF et PACF de la série \(X_1\)

- Dans l’activité 1, on a vu que l’ACF (autocorrélation) mesure la force du lien entre une valeur et celles situées à \(k\) périodes d’intervalle (le lag), tandis que la PACF (autocorrélation partielle) isole la relation directe en neutralisant les effets intermédiaires.

- Le graphique de l’ACF montre une décroissance progressive des corrélations avec l’augmentation du décalage : la mémoire du passé s’estompe peu à peu au fil des lags.

- Le graphique de la PACF présente deux pics marqués aux décalages 1 et 2, puis chute rapidement vers zéro pour les décalages suivants. Cette structure est caractéristique d’un modèle AR(2) : seules les deux valeurs précédentes influencent directement la valeur courante, les effets plus anciens devenant négligeables.

Le modèle à moyenne mobile (MA) – apaiser les eaux troubles

Le modèle à moyenne mobile (MA) repose sur une idée complémentaire au modèle autorégressif. Plutôt que d’utiliser les valeurs passées de la série, il s’appuie sur les erreurs passées – c’est-à-dire les écarts entre les valeurs observées et les valeurs prédites – pour affiner les estimations futures. En d’autres termes, le modèle « apprend » de ces erreurs : chaque nouvelle valeur corrige partiellement les imprécisions précédentes.

Mathématiquement, un modèle MA d’ordre \(q\), noté MA(q), s’écrit :

où : ![]()

- \(y_t\) est la valeur observée au temps \(t\) ;

- \(\mu\) est la moyenne (ou constante) du processus ;

- \(\varepsilon_t\) est le bruit (terme aléatoire) ;

- les coefficients \(\theta_i\) mesurent l’influence des erreurs passées sur la valeur actuelle.

Dans ce type de modèle, les coefficients d’autocorrélation (théoriques) sont nuls après un décalage \(k > q\). Cela signifie que la dépendance temporelle est de courte portée : seules les \(q\) erreurs les plus récentes ont un effet direct sur la valeur présente.

Inversibilité : Afin de définir de façon unique les autocorrélations, on demande la condition d’inversibilité, c’est-à-dire que les racines (possiblement complexes) du polynôme

$$\theta(z) = 1 + \theta_1 z + \cdots + \theta_q z^q$$

soient à l’extérieur du cercle unité. En effet, si cette condition n’est pas remplie, le modèle \(y_t = \varepsilon_t + \frac{1}{\theta}\varepsilon_{t-1}\) a la même fonction d’autocorrélation que \(y_t = \varepsilon_t + \theta\varepsilon_{t-1}\).

Un exemple pratique : illustration d’un modèle MA(q)

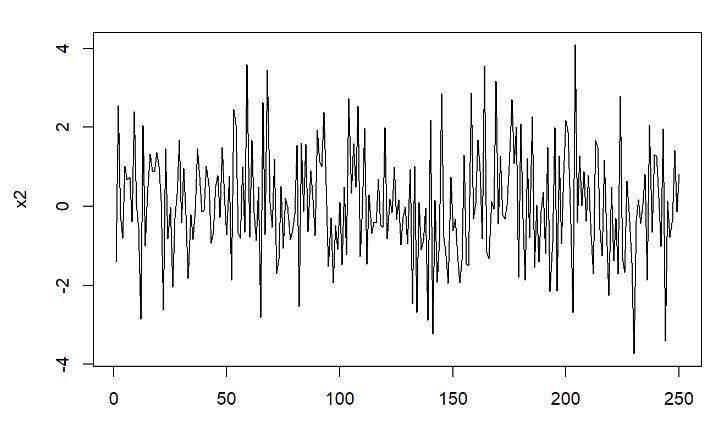

Pour visualiser les comportements des modèles MA, considérons une série simulée selon le modèle :

$$y_t = \varepsilon_t – 0,2\varepsilon_{t-1} + 0,2\varepsilon_{t-2}$$

Cette équation décrit un processus MA(2), où les erreurs des deux dernières périodes influencent encore la valeur actuelle, mais où les erreurs plus anciennes n’ont plus d’effet.

Les coefficients \(\theta_1 = -0,2\) et \(\theta_2 = 0,2\) traduisent la manière dont les erreurs passées influencent la valeur actuelle de la série.

- Le coefficient négatif \(\theta_1 = -0,2\) signifie que, si une erreur positive a eu lieu à la période précédente \((t – 1)\), elle aura tendance à réduire légèrement la valeur observée actuelle. Autrement dit, la série corrige partiellement les écarts récents.

- Le coefficient positif \(\theta_2 = 0,2\) indique qu’une erreur d’il y a deux périodes \((t – 2)\) a un effet inverse, contribuant cette fois à augmenter la valeur présente.

- Comme ces coefficients sont de petite amplitude \((\pm 0,2)\), leur effet reste modéré : la mémoire temporelle est courte et l’influence du passé s’amortit rapidement.

D’un point de vue intuitif, ces coefficients fonctionnent un peu comme des poids correcteurs : ils ajustent les prévisions en tenant compte des écarts récents, mais avec une influence décroissante à mesure que l’on remonte dans le temps.

Représentation graphique de la série temporelle \(X_2\)

- La série \(X_2\) fluctue de manière irrégulière autour d’une moyenne stable, sans tendance ni cycle.

- Ce comportement est typique d’un processus de moyenne mobile : il semble aléatoire, mais conserve une structure interne liée aux erreurs passées.

Représentations graphiques des fonctions ACF et PACF de la série \(X_2\)

- Dans le graphique de l’ACF, on observe des corrélations significatives aux deux premiers décalages, puis une décroissance rapide vers zéro. Cela suggère que la dépendance temporelle s’éteint rapidement, comme attendu pour un MA(2).

- Le graphique de la PACF ne montre pas de coupure nette, mais plutôt des valeurs faibles et irrégulières après les premiers lags, ce qui est également cohérent avec un processus de moyenne mobile.

Remarque à propos de l’interprétation des graphiques ACF et PACF pour les modèles AR et MA

On a vu précédemment que :

- l’ACF mesure les corrélations globales entre valeurs séparées par k périodes ;

- la PACF identifie les relations directes entre deux moments, une fois les effets intermédiaires neutralisés.

Chez les modèles AR et MA, ces fonctions peuvent avoir des signatures caractéristiques :

- un modèle AR(p) tend à produire une ACF qui décroît graduellement et une PACF qui devient négligeable au-delà du lag p ;

- un modèle MA(q) présente souvent une ACF qui chute rapidement après le lag q et une PACF qui diminue progressivement.

Ces tendances doivent toutefois être interprétées avec prudence, car elles sont théoriques et peuvent être atténuées ou perturbées dans les séries réelles ou les échantillons simulés de petite taille.