Les modèles ARMA constituent une base essentielle pour analyser et prévoir les séries chronologiques. Ils reposent toutefois sur certaines hypothèses fortes : ils supposent que les relations entre les valeurs passées et présentes sont linéaires et constantes dans le temps, et que la variabilité de la série (sa variance) demeure stable.

Or, ces hypothèses ne sont pas toujours vérifiées dans les données réelles. En santé publique, les phénomènes observés sont souvent plus instables, influencés par des événements extérieurs ou des changements brusques. Par exemple :

- Durant la pandémie de COVID-19, les cycles de transmission ont été profondément modifiés par les mesures de confinement, les campagnes de vaccination ou l’émergence de nouveaux variants.

- Dans le cas de la dengue, la fréquence et l’intensité des épidémies varient selon les saisons et les conditions climatiques, entraînant des fluctuations soudaines du nombre de cas.

Ces situations illustrent deux limites majeures des modèles ARMA :

- Ils ne tiennent pas compte des changements structurels dans le temps (p. ex. le passage d’une phase endémique à une flambée épidémique).

- Ils supposent une variabilité constante, alors que les données peuvent présenter des périodes de calme suivies de pics de volatilité importants.

Pour mieux décrire ces dynamiques, d’autres familles de modèles ont été développées :

- Les modèles ARCH et GARCH, qui prolongent la logique des modèles ARMA en relâchant l’hypothèse de variance constante. Ils permettent de représenter des périodes calmes suivies de phases de forte variabilité, souvent observées dans les séries épidémiologiques.

- Les modèles à changements de régimes ou modèles de Markov cachés (Hidden Markov Model, HMM), qui reposent sur un principe différent en décrivant la succession de plusieurs états possibles du système, par exemple le passage d’une phase endémique à une phase épidémique.

Ces approches, plus flexibles, offrent une vision plus réaliste des phénomènes complexes en épidémiologie.

Les sections qui suivent traitent de ces deux familles de modèles, ARCH/GARCH et HMM, en mettant l’accent sur leurs principes fondamentaux sans entrer dans les détails techniques. Pour les personnes qui veulent approfondir le sujet, des références complémentaires et des liens vers des ressources spécialisées sont proposés dans la section Références.

Le modèle ARCH : capturer les orages de volatilité

Dans certaines séries chronologiques, la variabilité évolue au fil du temps. On observe alors des périodes calmes suivies d’épisodes très instables, où les fluctuations deviennent soudainement plus fortes. Ce phénomène, appelé « hétéroscédasticité conditionnelle », est fréquent dans les domaines où l’incertitude varie rapidement, comme la finance et l’épidémiologie.

Par exemple, dans le cas de la COVID-19 ![]() , les fluctuations du nombre de cas n’ont pas toujours été régulières. Après plusieurs semaines de stabilité, de fortes hausses pouvaient survenir, souvent en lien avec des changements de politiques publiques, le comportement de la population ou l’émergence de nouveaux variants.

, les fluctuations du nombre de cas n’ont pas toujours été régulières. Après plusieurs semaines de stabilité, de fortes hausses pouvaient survenir, souvent en lien avec des changements de politiques publiques, le comportement de la population ou l’émergence de nouveaux variants.

Les modèles ARCH (Autoregressive Conditional Heteroskedasticity) ont justement été conçus pour représenter ces variations de volatilité. Contrairement aux modèles ARMA, qui supposent une variance constante, les modèles ARCH permettent à la variance des erreurs (l’ampleur des fluctuations aléatoires) d’évoluer dans le temps. Cela est particulièrement utile pour les séries chronologiques affichant une variance de la série non constante avec des périodes de volatilité, comme celles observées lors de flambées épidémiques.

Mathématiquement, le modèle s’écrit : ![]()

$$y_t = \mu + \sigma_t \varepsilon_t$$

$$\sigma_t^2 = \omega + \sum_{i=1}^{q} \alpha_i(y_{t-i} – \mu)^2$$

où :

- \(y_t\) est la valeur observée au temps \(t\) ;

- \(\mu\) représente la moyenne du processus ;

- \(\varepsilon_t\) est l’erreur aléatoire de moyenne nulle et de variance égale à 1 ;

- \(\sigma_t^2\) correspond à la variance conditionnelle des erreurs au temps \(t\), qui dépend des erreurs passées ;

- \(\omega\) est une constante positive qui fixe le niveau minimal de variance, même lorsque les fluctuations récentes sont faibles ;

- \(\alpha_i\) (\(\geq 0\)) mesure l’impact des chocs passés sur la volatilité actuelle :

- si \(\alpha_i\) est grand, cela signifie que les fortes variations du passé entraînent une forte volatilité à court terme ;

- si \(\alpha_i\) est faible, la volatilité revient rapidement à un niveau plus stable ;

- \((y_{t-i} – \mu)^2\) correspond à la taille du choc (ou de l’erreur) observé à la période \(t – i\) : plus cette valeur est grande, plus elle augmente la variance dans les périodes suivantes.

Ainsi, si une période présente une forte erreur (grande déviation par rapport à la moyenne), la variance des périodes suivantes sera plus élevée ; en d’autres termes, le modèle « se souvient » de la volatilité passée.

En épidémiologie, cela revient à dire qu’après une flambée importante de cas, la probabilité d’observer d’autres variations extrêmes à court terme est plus forte, une propriété souvent vérifiée dans les maladies à transmission rapide.

Condition de non-explosion de la variance

Il faut que :

$$\sum_{i=1}^{q} \alpha_i < 1$$

Dans ce cas, la variance à long terme est donnée par :

$$\frac{\omega}{1 – \displaystyle\sum_{i=1}^{q} \alpha_i}$$

Le modèle GARCH : l’œil du cyclone

Le modèle GARCH ![]() (Generalized Autoregressive Conditional Heteroskedasticity) prolonge l’intuition du modèle ARCH. Il ajoute une mémoire supplémentaire en tenant compte non seulement des erreurs passées, mais aussi des variances conditionnelles passées, ce qui permet de représenter plus finement la persistance de la volatilité dans le temps.

(Generalized Autoregressive Conditional Heteroskedasticity) prolonge l’intuition du modèle ARCH. Il ajoute une mémoire supplémentaire en tenant compte non seulement des erreurs passées, mais aussi des variances conditionnelles passées, ce qui permet de représenter plus finement la persistance de la volatilité dans le temps.

Mathématiquement, on a :

$$y_t = \mu + \sigma_t \varepsilon_t$$

$$\sigma_t^2 = \omega + \sum_{j=1}^{p} \beta_j \sigma_{t-j}^2 + \sum_{i=1}^{q} \alpha_i(y_{t-i} – \mu)^2$$

où :

- \(\beta_j\) (\(\geq 0\)) indique la persistance de la volatilité : si une période a été instable, les prochaines le resteront encore quelque temps ;

- \(\sum_{i=1}^{q} \alpha_i(y_{t-i} – \mu)^2\) capte l’impact direct des chocs récents ;

- \(\sum_{j=1}^{p} \beta_j \sigma_{t-j}^2\) mesure la mémoire de la variance.

Condition de non-explosion de la variance

Il faut que :

$$\sum_{j=1}^{p} \beta_j + \sum_{i=1}^{q} \alpha_i < 1$$

Dans ce cas, la variance à long terme est donnée par :

$$\frac{\omega}{1 – \displaystyle\sum_{j=1}^{p} \beta_j – \displaystyle\sum_{i=1}^{q} \alpha_i}$$

Quand utiliser un modèle ARCH ou GARCH ?

Le modèle ARCH est le plus simple à utiliser, car il suppose que la volatilité actuelle dépend uniquement des chocs passés (les carrés des erreurs précédentes). Il est particulièrement utile lorsque les fluctuations de la série sont brèves et localisées, par exemple, pour décrire un phénomène où la variabilité augmente temporairement après une flambée épidémique, puis revient rapidement à un niveau stable.

Le modèle GARCH, quant à lui, ajoute une mémoire de la variance en prenant en considération non seulement les chocs passés, mais aussi les variances conditionnelles antérieures. Il devient nécessaire lorsque les épisodes de volatilité sont persistants, c’est-à-dire lorsque les périodes calmes et les périodes instables s’enchaînent lentement.

En d’autres termes :

- ARCH capture les pics ponctuels de volatilité (réaction immédiate à un choc) ;

- GARCH décrit les régimes prolongés de volatilité (effet durable de l’instabilité).

En pratique, on teste d’abord un modèle ARCH simple pour vérifier si la variance des résidus présente une dépendance temporelle (autocorrélation des carrés des erreurs). Ce n’est que si cette dépendance persiste qu’un modèle GARCH, plus général et plus stable, est justifié.

Ainsi, le choix entre ARCH et GARCH repose sur un compromis entre simplicité (moins de paramètres, plus facile à interpréter) et réalisme (meilleure prise en compte des fluctuations persistantes).

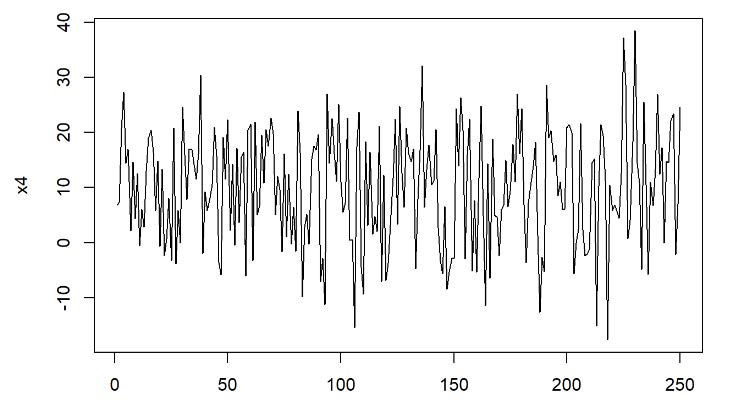

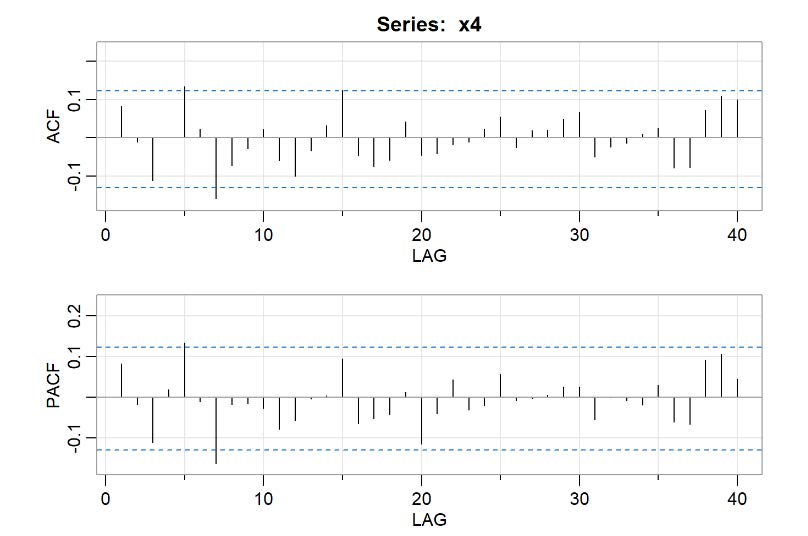

Pour illustrer ces processus, nous avons simulé un modèle GARCH(1,1) ![]() avec une moyenne de 10. Les figures suivantes montrent la série temporelle générée et les fonctions ACF et PACF correspondantes. On remarque que les valeurs oscillent autour d’une moyenne stable, mais que l’ampleur des fluctuations change : certaines périodes sont calmes, d’autres présentent des pics soudains.

avec une moyenne de 10. Les figures suivantes montrent la série temporelle générée et les fonctions ACF et PACF correspondantes. On remarque que les valeurs oscillent autour d’une moyenne stable, mais que l’ampleur des fluctuations change : certaines périodes sont calmes, d’autres présentent des pics soudains.

Représentation graphique de la série temporelle \(X_4\)

- La série \(X_4\) montre une alternance entre périodes de faible et de forte volatilité.

- Les amplitudes varient, bien que la moyenne demeure stable, ce qui illustre le principe même du modèle : la dépendance se trouve dans la variance et non dans la moyenne.

Représentations graphiques des fonctions ACF et PACF de la série \(X_4\)

- Les courbes de l’ACF et de la PACF ne révèlent pas de structure temporelle nette dans la moyenne (comme pour un bruit blanc).

- Cependant, si l’on calculait les ACF/PACF sur les carrés des résidus \((\varepsilon_t^2)\), on observerait une dépendance significative : c’est là que se manifeste la mémoire de la volatilité.

- En pratique, ce comportement distingue les séries ARCH/GARCH des modèles ARMA classiques.

Extension : Modèle AR-GARCH

Dans ce cas, la moyenne dépend aussi du temps et s’écrit comme un modèle AR(p). On remplace donc \(\mu\) par \(\mu_t\), où :

$$\mu_t = \mu_0 + \sum_{j=1}^{p} \phi_j y_{t-j}$$

Les modèles ARCH et GARCH sont très utiles pour décrire des séries à variance non constante, mais ils reposent sur l’hypothèse d’une dynamique unique et continue.

Lorsqu’une série présente plutôt des régimes distincts (par exemple, des alternances entre phases calmes et phases épidémiques bien séparées), d’autres modèles, comme les modèles à changement de régimes ou modèles de Markov cachés (HMM), deviennent plus appropriés. Ces derniers seront présentés dans la section suivante.